Το σχολείο και ο πύραυλος: Αλγόριθμοι είναι, λάθη κάνουν!

Διαβάζεται σε 4'

Ήταν στοχευμένη η τραγωδία στο δημοτικό σχολείο θηλέων στο Ιράν; Προφανώς όχι, σύμφωνα με τα δημοσιεύματα και την κοινή λογική. Αν όμως υπήρξε λάθος, πού οφείλεται αυτό;

- 28 Μαρτίου 2026 08:14

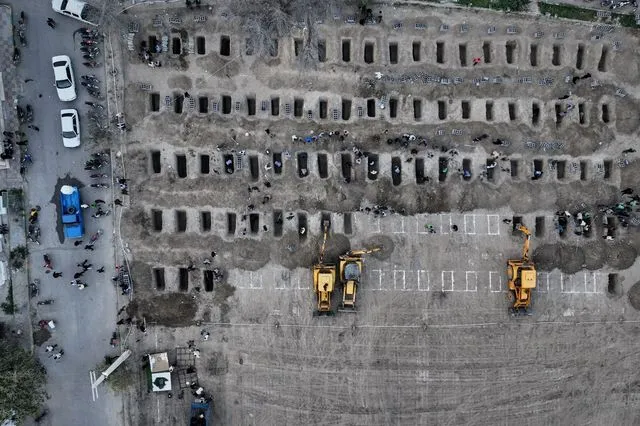

Το περιστατικό, στις γενικές του γραμμές είναι δεδομένο: Ένας πύραυλος Tomahawk έπληξε δημοτικό σχολείο θηλέων στην πόλη Μινάμπ του νότιου Ιράν (28 Φεβρουαρίου 2026) με αποτέλεσμα περίπου 170 άνθρωποι, κυρίως μαθήτριες, να χάσουν τη ζωή τους. Γράφω «στις γενικές του γραμμές», επειδή ο ΟΗΕ, ως μόνος «τρίτος» που από ηθική και πραγματική άποψη μπορεί να κρίνει τί έγινε, έχει ξεκινήσει αλλά δεν έχει ολοκληρώσει τη σχετική έρευνά του.

Ήταν στοχευμένη η τραγωδία; Προφανώς όχι, σύμφωνα με τα δημοσιεύματα και την κοινή λογική. Αν όμως υπήρξε λάθος, πού οφείλεται αυτό; Μήπως μπορεί να αποδοθεί στα συστήματα της τεχνητής νοημοσύνης που χρησιμοποιήθηκαν; Έθεσα το ερώτημα στα προηγμένα τεχνολογικά εργαλεία διαλόγου (gemini, claude ai κλπ) και οι απαντήσεις τους συγκλίνουν: Το τραγικό πολύνεκρο συμβάν αποδίδεται κυρίως σε ανθρώπινο λάθος, κι όχι σε βαρβαρότητα ή σε δυσλειτουργία ενός ανεξέλεγκτου αλγορίθμου της τεχνητής νοημοσύνης.

Αυτοαπαλλάσσεται λοιπόν η ψηφιακή μηχανή. Και, ολοφάνερα, έχει δίκιο. Κάποιο λάθος στην εισαγωγή των δεδομένων, κάποια μεταβολή στη χρήση των εγκαταστάσεων που στοχοποιήθηκαν, δεν θα έγινε αντιληπτή. Λάθη είμαστε, ανθρώπους κάνουμε, λέει η λαϊκή σοφία. Όμως η απάντηση αυτή δεν κλείνει, αλλά ανοίγει μια συζήτηση υπαρξιακής σημασίας για τον κόσμο . Ως τώρα, αφορούσε θεωρητικό πρόβλημα. Σήμερα, αφορά μια πραγματωμένη πολύνεκρη τραγωδία.

Όσο το αυτοπροσδιοριζόμενο ρομπότ – agent με την υπερνοημοσύνη δεν έχει κατασκευαστεί*, οι ευθύνες προφανώς είναι ανθρώπινες. Αυτό όμως καθόλου δεν σημαίνει ότι το εργαλείο καθαυτό είναι ουδέτερο και ακίνδυνο. Το μηχάνημα μπορεί να είναι σωτήριο αλλά και επικίνδυνο, όχι μόνο λόγω καλής ή κακής χρήσης αλλά και εκ κατασκευής. Όπως άλλωστε υπάρχουν τοξικά δηλητήρια, ραδιενεργές ακτινοβολίες καθώς και πυροβόλα όπλα (Lethal Automated Weapon Systems, με το σαρκαστικό αρκτικόλεξο LAWS = νόμοι). Μπορεί να είναι κυρίαρχη και εύληπτη σαν καραμέλα η άποψη ότι το ίδιο το εργαλείο είναι ουδέτερο και ότι σε τίποτε δεν φταίει, αλλά η κριτική προσέγγιση δυναμώνει: To μηχάνημα γίνεται αντιληπτικό όργανο, λέγεται, εκφράζει μια πολιτική**. Έτσι, αντιτάσσεται από δυνατές φωνές πως η δημιουργία μιας τεχνητής νοημοσύνης με δημοκρατικά, επιεική και συμμετοχικά χαρακτηριστικά είναι εφικτή, και πως η αποφυγή της αποτελεί πολιτική επιλογή***.

Μεταφέρω δυο-τρεις γραμμές από την ενδιαφέρουσα απάντηση του claude ai στο ερώτημά μου: «Και σε στρατιωτικές επιχειρήσεις .. η τελική ευθύνη παραμένει ανθρώπινη. Το ερώτημα που τίθεται είναι αν η υπερβολική εμπιστοσύνη σε αυτοματοποιημένα συστήματα μειώνει την ανθρώπινη επαγρύπνηση που θα μπορούσε να αποτρέψει ανάλογες τραγωδίες».

Χωρίς ευθύνη πραγματικά δεν μπορεί να υπάρχει ούτε ελευθερία, ούτε κοινωνία, ούτε πολιτισμός. Ας μην το προσπερνάμε, δεν ήταν ποτέ και δεν είναι αυτονόητο. Η παγκόσμια κοινότητα, δηλαδή ο ΟΗΕ, πρέπει να σπεύσει, να επιταχύνει τη δημιουργία εγγυητικών ρυθμίσεων απέναντι στην ανάπτυξη αυτόματων θανατηφόρων συστημάτων, να καθιερώσει ανθρώπινες διαβουλεύσεις με διαφάνεια και με καταγραφές της διεξαγωγής τους ****. Δεν λέω ότι η θεσμική ασπίδα θα είναι επαρκής, κάθε άλλο: Μια αποτρεπτική συμβολή όμως ως ηθικό όριο οπωσδήποτε θα έχει. Η αποτροπή προϋποθέτει έγκαιρη αναγνώριση επικίνδυνων κατασκευών, ενώ το Διεθνές Ανθρωπιστικό Δίκαιο αναπόφευκτα επεμβαίνει κατασταλτικά και καθυστερημένα.

Αν οι ένοχοι δεν θα πληρώνουν, πρόληψη των τραγωδιών ούτε κατά διάνοια θα έχουμε! Το έλεγε και ο μεγάλος Σταγειρίτης: Χάρη στην ανάλογη ανταπόδοση διατηρεί τη συνοχή της (συμμένει) η πόλη*****.

ΣΗΜΕΙΩΣΕΙΣ

*S. Chopra-L.F. White, A Legal Theory for Autonomous Artificial Agents. The University of Michigan Press, 2011, N. Bostrom, Superintelligence. Paths, Dangers, Strategies. Oxford University Press, 2014 (repr. 2017).

** Απόψεις των φιλοσόφων Langton Winner, Don Ihde. Σχετικά αποσπάσματα και σχόλια στο συλλογικό Φιλοσοφία του ψηφιακού. Μια εισαγωγή. (Επ. Γ. Μαγγίνη) Πανεπιστημιακές Εκδόσεις Κρήτης, 2024.

***M. Coeckelberg, Why AI undemines Democracy and what to do about it, Polity, 2024, σελ. 21.

**** Αναλυτικότερα σε παλιότερα κείμενα: Ν. Παρασκευόπουλου, Τεχνητή Νοημοσύνη: Προς ένα παγκόσμιο θεσμικό πλαίσιο, σε Θεωρία και πράξη στις διεθνείς σχέσεις. Δοκίμια προς τιμήν του Δημήτρη Κώνστα (επ. Μ. Κοππά, Π. Τσάκωνα), Παπαζήσης, 2024, σελ. 447-461, και στο βιβλίο Ο επιεικής αλγόριθμος. Από την αριστοτελική σκέψη στην Τεχνητή Νοημοσύνη, Ινστιτούτο Νεοελληνικών Σπουδών (Ίδρυμα Τριανταφυλλίδη) ΑΠΘ, 2024.

***** Αριστοτέλης, Ηθικά Νικομάχεια, Ε 1132 β 36-39.