AI εικόνες της “σύλληψης” Μαδούρο γίνονται viral και τροφοδοτούν την παραπληροφόρηση

Διαβάζεται σε 3'

Εικόνες και βίντεο τεχνητής νοημοσύνης από τη στιγμή της αρπαγής του Νικολάς Μαδούρο συγκέντρωσαν εκατομμύρια προβολές και έγιναν viral στα social media μετά την ανακοίνωση Τραμπ για επίθεση στη Βενεζουέλα, τροφοδοτόντας την παραπληροφόρηση σε ένα τέτοιο κρίσιμο ζήτημα.

- 06 Ιανουαρίου 2026 16:18

Λίγα λεπτά αφότου ο Ντόναλντ Τραμπ ανακοίνωσε νωρίς το πρωί του Σαββάτου (3/1) μια «ευρείας κλίμακας επίθεση» κατά της Βενεζουέλας, τα μέσα κοινωνικής δικτύωσης κατακλύστηκαν από ψευδείς και παραπλανητικές εικόνες που είχαν δημιουργηθεί με τεχνητή νοημοσύνη. Ανάμεσά τους κυκλοφόρησαν υποτιθέμενες φωτογραφίες του Νικολάς Μαδούρο να συνοδεύεται εκτός αεροσκάφους από Αμερικανούς πράκτορες, εικόνες με πανηγυρισμούς στους δρόμους του Καράκας και βίντεο που έδειχναν πυραύλους να πλήττουν την πόλη, όλα είχαν παραχθεί με ΑΙ.

Το ψεύτικο υλικό αναμείχθηκε με αυθεντικά βίντεο και φωτογραφίες αμερικανικών αεροσκαφών πάνω από τη βενεζουελάνικη πρωτεύουσα και εκρήξεις που φώτιζαν τον νυχτερινό ουρανό. Η έλλειψη επιβεβαιωμένης πληροφόρησης για την επιχείρηση, σε συνδυασμό με τις ολοένα πιο προηγμένες δυνατότητες των εργαλείων τεχνητής νοημοσύνης, έκανε εξαιρετικά δύσκολο τον εντοπισμό του τι είναι πραγματικό και τι ψεύτικο.

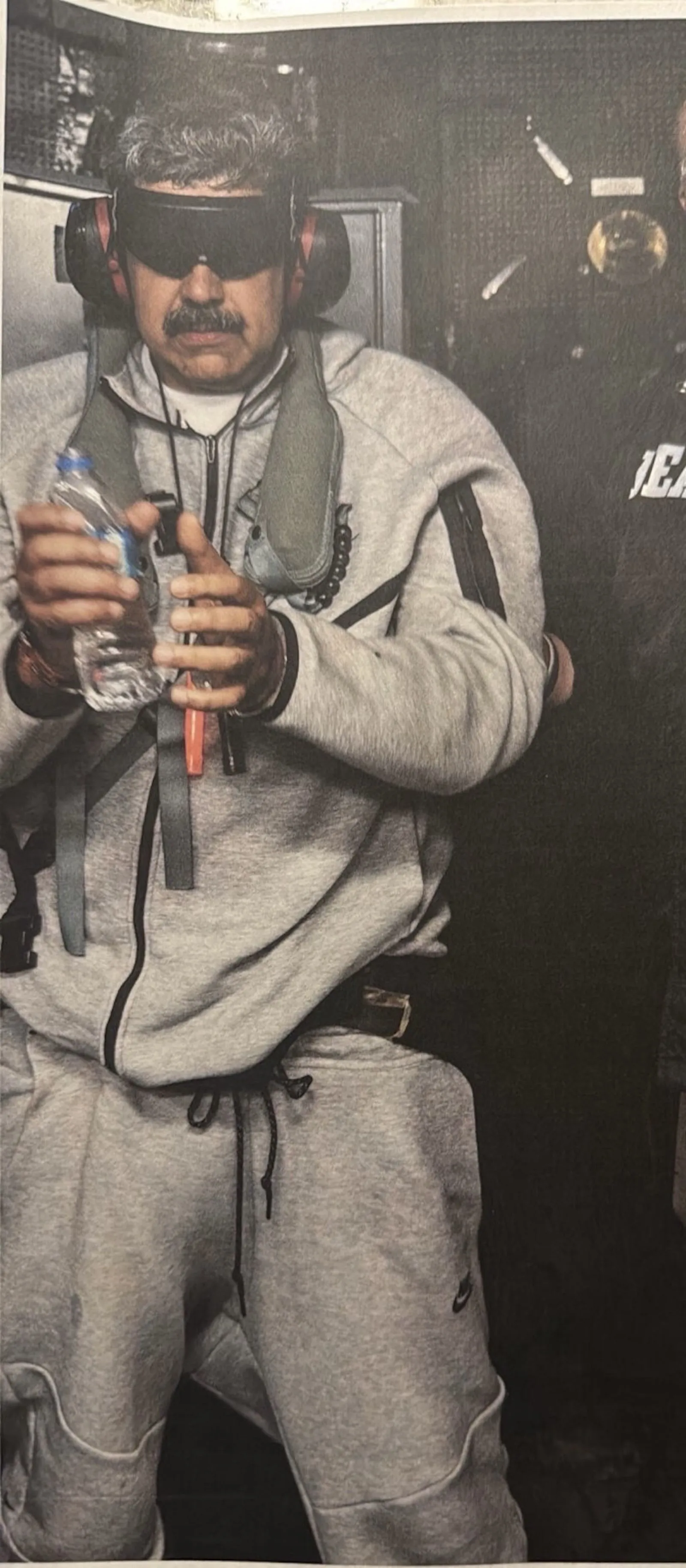

Μέχρι τη στιγμή που ο Τραμπ ανήρτησε επαληθευμένη φωτογραφία του Μαδούρο με δεμένα μάτια, χειροπέδες και γκρι φόρμα πάνω στο πολεμικό πλοίο USS Iwo Jima, οι ψεύτικες εικόνες με πράκτορες της Υπηρεσίας Δίωξης Ναρκωτικών των ΗΠΑ (DEA) είχαν ήδη γίνει viral. Σύμφωνα με τον οργανισμό ελέγχου αξιοπιστίας NewsGuard, οι εικόνες αυτές προβλήθηκαν και κοινοποιήθηκαν εκατομμύρια φορές σε X, Instagram, Facebook και TikTok.

Εργαλεία εντοπισμού αλλοιωμένου περιεχομένου, όπως η αντίστροφη αναζήτηση εικόνων και οι πλατφόρμες ανίχνευσης AI, μπορούν να βοηθήσουν, όμως τα αποτελέσματά τους δεν είναι πάντα αξιόπιστα. Όπως εξηγεί στον Guardian η Σοφία Ρούμπινσον, ανώτερη συντάκτρια του NewsGuard, πολλές από τις ψεύτικες εικόνες μοιάζουν πολύ με πραγματικά γεγονότα, γεγονός που δυσκολεύει ακόμη περισσότερο τον έλεγχο.

Σε πρόσφατη έκθεσή του, το NewsGuard εντόπισε πέντε κατασκευασμένες ή εκτός πλαισίου φωτογραφίες και δύο παραπλανητικά βίντεο που σχετίζονται με τη στρατιωτική επιχείρηση στη Βενεζουέλα. Μία εικόνα δείχνει έναν στρατιώτη να ποζάρει δίπλα στον Μαδούρο με κουκούλα στο κεφάλι, ενώ ένα βίντεο παρουσιάζει ελικόπτερο αμερικανικών ειδικών δυνάμεων να επιχειρεί σε υποτιθέμενη βάση στη Βενεζουέλα – το υλικό, ωστόσο, είχε τραβηχτεί τον Ιούνιο στο Fort Bragg της Βόρειας Καρολίνας. Τα επτά αυτά οπτικά έχουν συγκεντρώσει περισσότερες από 14 εκατομμύρια προβολές μόνο στο X.

Παράλληλα, κυκλοφορεί και παλαιότερο οπτικό υλικό που παρουσιάζεται ψευδώς ως τρέχον. Η ακροδεξιά influencer Λόρα Λούμερ ανήρτησε βίντεο με αφίσες του Μαδούρο να κατεβαίνουν, ισχυριζόμενη ότι πρόκειται για τρέχουσες αντιδράσεις, αν και –σύμφωνα με το Wired– το υλικό προέρχεται από το 2024. Αντίστοιχα, ο Άλεξ Τζόουνς ανήρτησε βίντεο με πλήθη στο Καράκας, το οποίο αποδείχθηκε ότι ήταν τουλάχιστον 18 μηνών και σχετιζόταν με διαδηλώσεις μετά τις εκλογές του Ιουλίου 2024.

Ακόμη και το Grok, το chatbot τεχνητής νοημοσύνης του X, αμφισβήτησε τους ισχυρισμούς, σημειώνοντας ότι δεν υπάρχουν ενδείξεις πανηγυρισμών στο Καράκας, αλλά αντίθετα συγκεντρώσεις υπέρ του Μαδούρο.

Οι Meta, X και TikTok δεν απάντησαν σε αιτήματα για σχόλιο, την ώρα που η υπόθεση αναδεικνύει για ακόμη μία φορά πόσο εύκολα η τεχνητή νοημοσύνη μπορεί να μετατραπεί σε εργαλείο μαζικής παραπληροφόρησης σε περιόδους κρίσης.